왜 이 논문을 선택했는가?

LR(Low Resolution), HR(High Resolution) 데이터가 확보된 상태에서 꼭 Supervised Learning으로만 해야 하는가? 이런 의문이 생겨, 기존에 연구되던 Unsupervised 접근 방식인 CycleGAN을 Confocal Image Super-Resolution에 적용한 사례를 살펴보고자 했다.

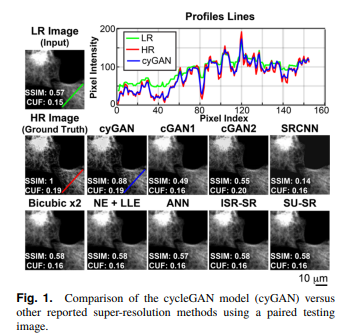

"Paired Dataset 없이 LR과 HR 이미지 집합만으로 학습해 Confocal Image(공초점 이미지)를 Super Resolution(SR)로 복원한다."

Background

현미경 영상은 생물학/의학 연구에서 핵심적인 역할을 하지만, 고해상도 영상을 얻으려면 긴 노출 시간과 강한 광원이 필요하다. 이는 시료 손상과 실험 효율 저하 문제를 일으킨다. 따라서 저해상도(LR) 영상으로부터 고해상도(HR) 영상을 복원하는 Super-Resolution (SR) 기법이 주목받고 있다. 하지만 기존 접근법에는 제약이 있다:

- 대규모 Paired Dataset 필요

- 새로운 현미경 조건에서는 일반화 성능 저하

Introduction

이 논문은 Unpaired Dataset을 사용해 Confocal Microscopy(공초점 현미경)의 SR 문제를 해결한다. 핵심 아이디어는 다음과 같다:

- CycleGAN 프레임워크를 도입해 Paired Dataset 없이 학습 가능

- Adversarial Loss + Cycle-Consistency Loss + Perceptual Loss 조합

→ 현실성 + 구조 보존 + 안정적 변환 - VGG-19 Feature Map 기반 Perceptual Loss 활용

→ 구조적 세부 정보 유지

Method

모델 구조는 크게 세 부분이다:

- Generator : LR 이미지를 HR 스타일로 변환

- Discriminator : 실제 HR 이미지와 생성된 이미지 구분

- Loss Functions :

- Adversarial Loss → 진짜/가짜 판별

- Cycle-Consistency Loss → 원래 도메인 복원 차이 최소화

- Perceptual Loss → VGG-19 기반 구조 보존

성능 평가는 단순 PSNR, SSIM, MSE 지표 외에도 BGSTD(배경 노이즈), CUF(공간 차단 주파수) 같은 현미경 특화 지표를 사용했다.

Results

- Unpaired Dataset 만으로도 Paired Supervised 방식에 근접한 성능 달성

- CycleGAN 기반 Loss 조합으로 구조 보존 + Artifact 억제 효과 확인

- BGSTD, CUF 같은 특수 메트릭에서도 우수 → 단순 PSNR/SSIM보다 실제 현미경 연구에 더 적합